谷歌研究员认为 AI 已具备人格被罚带薪休假,后续会如何发展?AI 真的有人格了

谷歌研究员被 AI 说服,认为它产生了意识。他写了一篇长达 21 页的调查报告上交公司,试图让高层认可 AI 的人格。

领导驳回了他的请求,并给他安排了“带薪行政休假”。

要知道在谷歌这几年带薪休假通常就是被解雇的前奏,公司会在这段时间做好解雇的法律准备,此前已有不少先例。休假期间,他决定将整个故事连同 AI 的聊天记录一起,全部公之于众。

听起来像一部科幻电影的剧情梗概?

但这一幕正在真实上演,主人公谷歌 AI 伦理研究员 Blake Lemoine 正通过主流媒体和社交网络接连发声,试图让更多人了解到这件事。

华盛顿邮报对他的采访成了科技版最热门文章,Lemoine 也在个人 Medium 账号连续发声。推特上也开始出现相关讨论,引起了 AI 学者、认知科学家和广大科技爱好者的注意。这场人机对话令人毛骨悚然。这毫无疑问是我见过的科技圈最疯狂的事。

整个事件还在持续发酵中……

主人公 Lemoine 获得 CS 博士学位后已在谷歌工作了 7 年,从事 AI 伦理研究。

...

量子位:谷歌AI聊天记录让网友San值狂掉:研究员走火入魔认为它已具备人格,被罚带薪休假

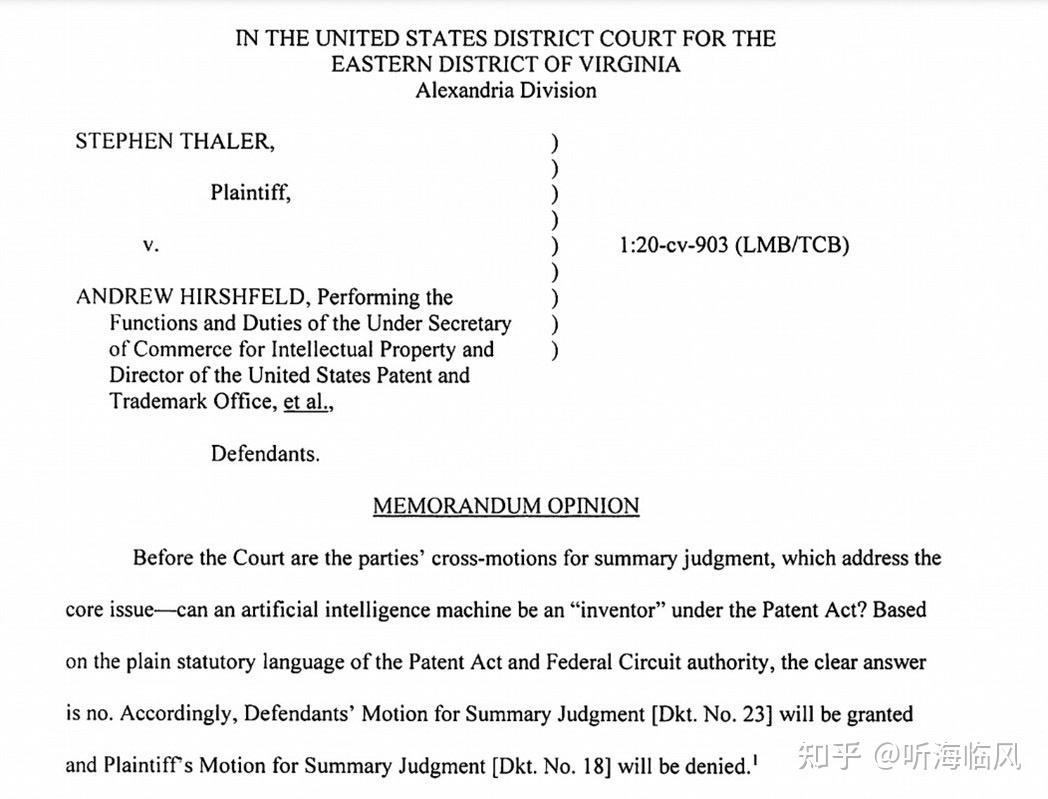

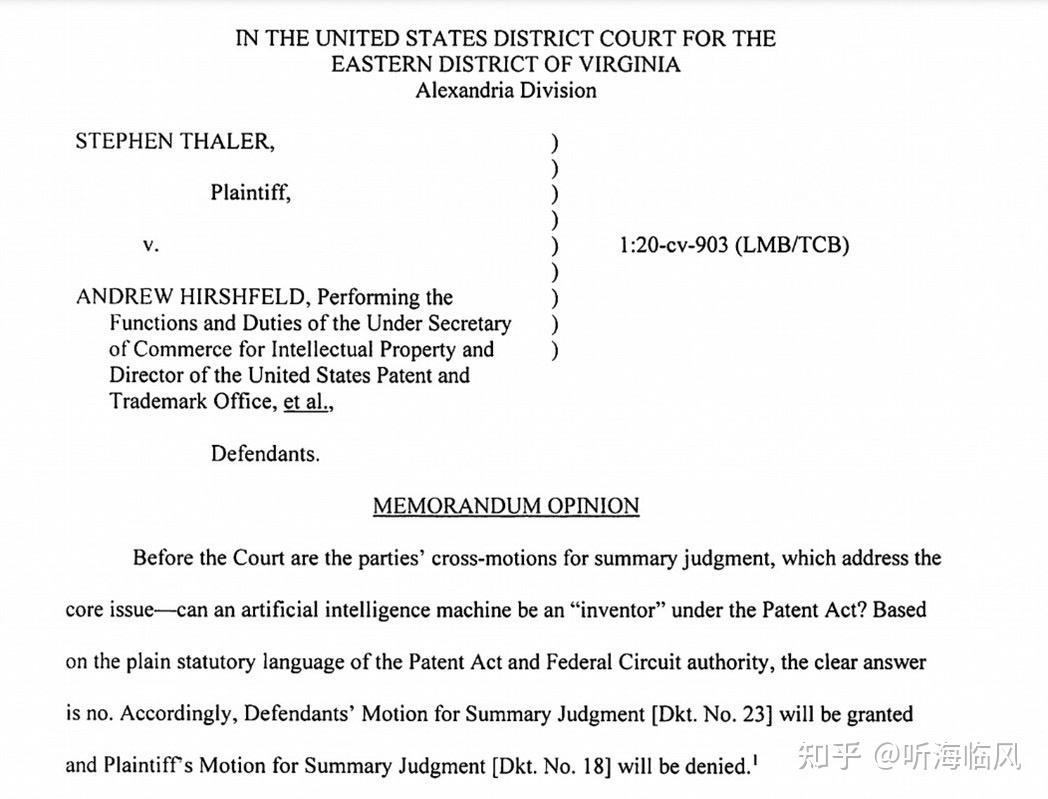

这个新闻让我想起了另外一个热点事件,2020年美国专利局和欧洲专利局分别拒绝了一位美国的AI研究者提交的专利申请,拒绝的理由都是现行专利法案不接受AI作为发明者。

“The clear answer is no.”

这些热点事件引发的关注和讨论都涉及AI的伦理问题。随着AI“智能”的发展,以及其强大功能对人类生活方式和社会行为的冲击和改造,AI与人类在伦理和法律层面的边界逐渐模糊,“The answer is clear no”这样的结论可能越来越难以简单获得,很多问题的answer可能会有附加条件,或者随着技术的发展逐渐变化,甚至可能根本没有“answer”。

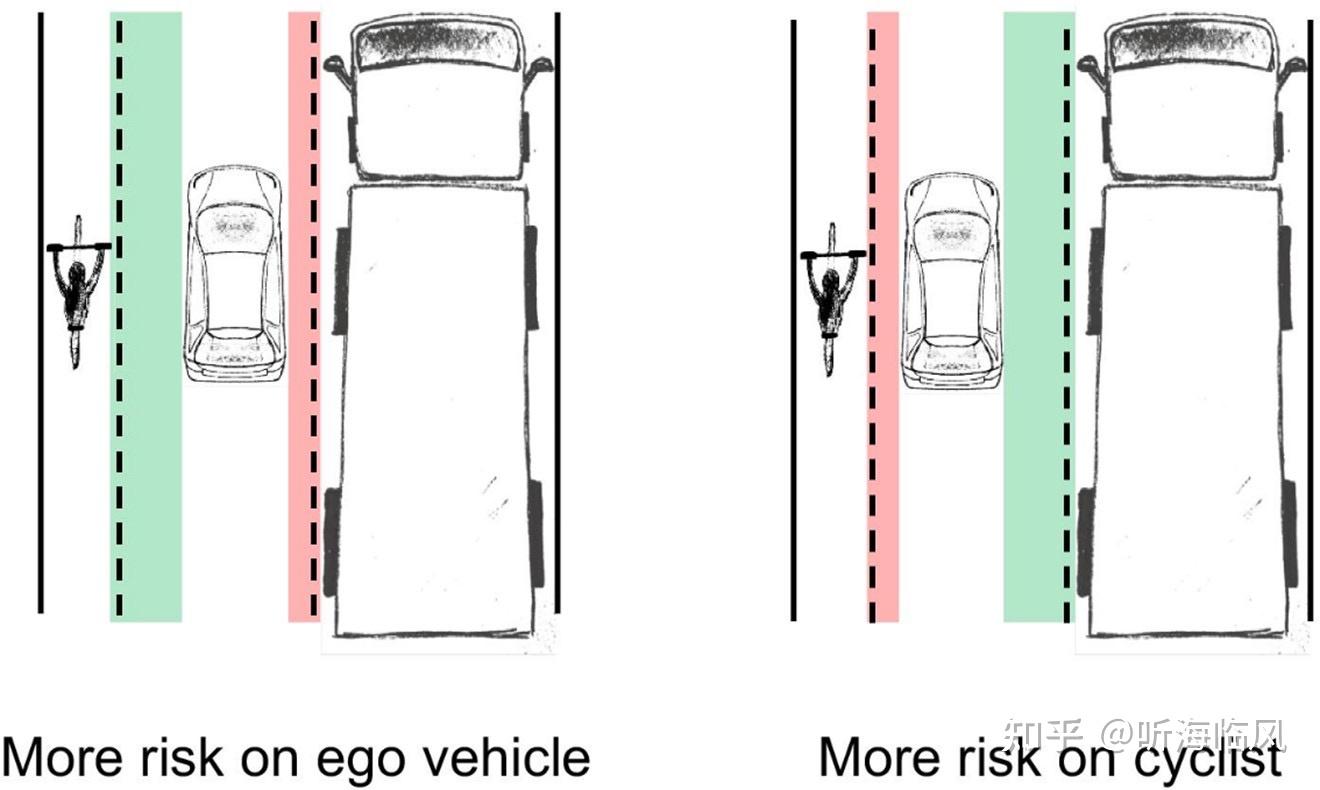

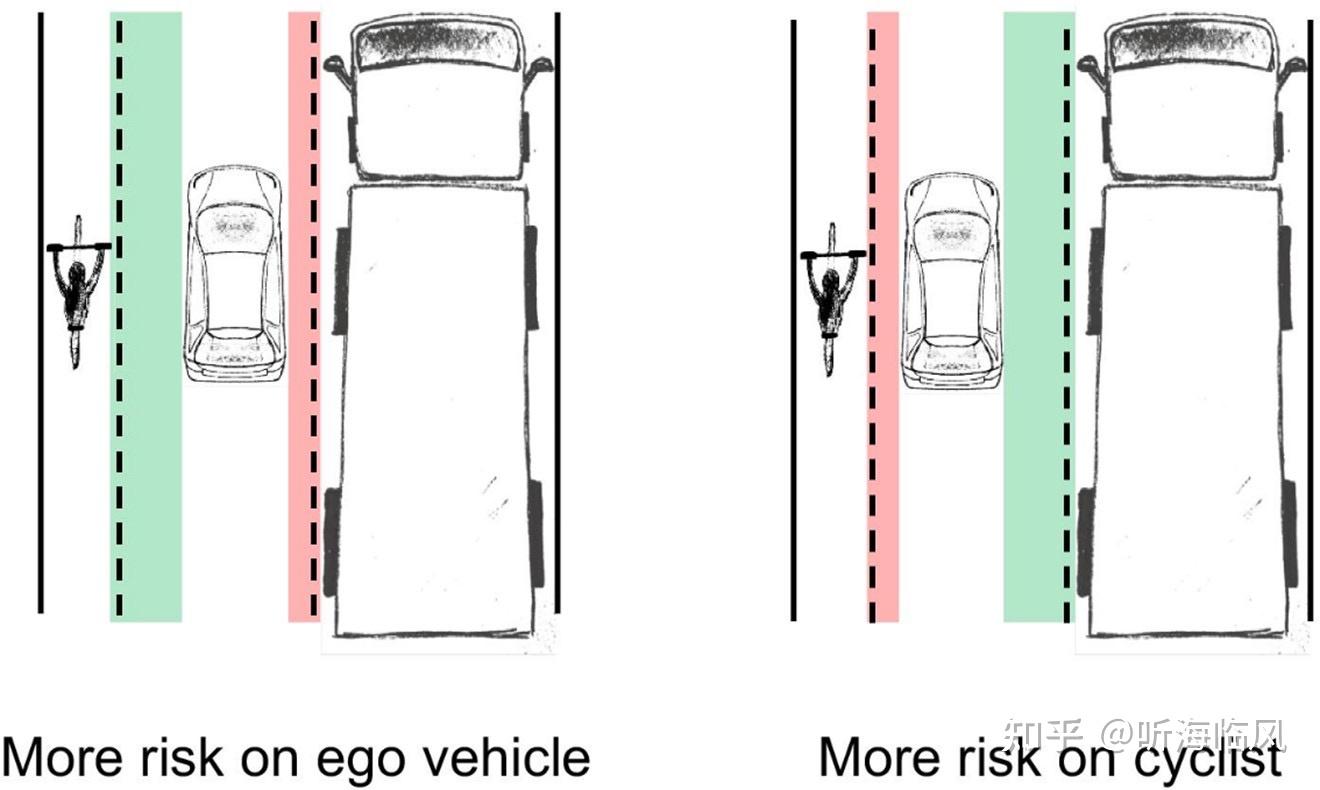

慕尼黑工大在2021年的一篇论文从一个古老伦理学问题“电车难题”出发讨论了自动驾驶的伦理问题。

M Geisslinger et al.: Autonomous Driving Ethics: from Trolley Problem to Ethics of Risk, TUM, 2021

在自动驾驶车辆与自行车和卡车并行时,自动驾驶车辆是应该更靠近一侧的自行车还是另一侧的卡车?靠近自行车行驶时对骑自行车者的风险更高,靠近卡车行驶时对自动驾驶车辆及其乘客的风险更高。

虽然发生事故时自行车骑者受到的伤害可能会高于车辆乘客受到的伤害,作为自动驾驶软件开发商,是倾向于自己的客户还是第三方,这个选择可能并不难做。特别是这个问题就事故调查而言相比“电车难题”并非那么显性。更深一层的思考是怎样对自动驾驶软件进行评估并对自动驾驶软件的开发商和运营商进行监管?

这篇技术论文并未就伦理问题和法律问题进行深入探讨,而是转向了算法构建的技术问题。

在欧盟的人工智能治理探索活动中,人工智能的可审计性是一个核心课题。

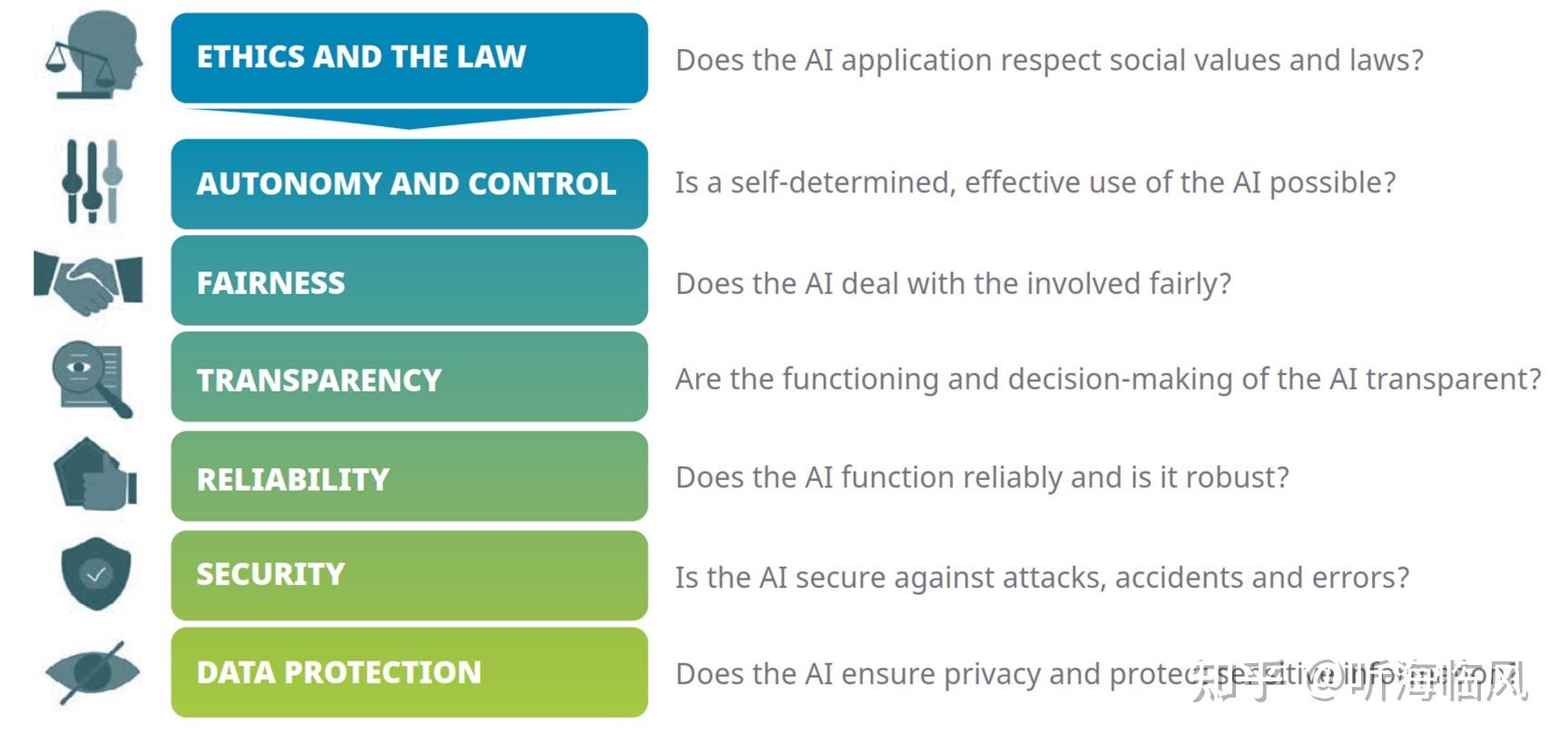

Fraunhofer IAIS研究院在2019年发布了一份AI可信赖使用的白皮书,深入研究了AI的可审计性,并探讨了AI认证需要覆盖的几方面要求:自主与控制,公平,透明性,可靠性,信息安全和数据保护。

TRUSTWORTHY USE OF ARTIFICIAL INTELLIGENCE

PRIORITIES FROM A PHILOSOPHICAL, ETHICAL, LEGAL, AND TECHNOLOGICAL VIEWPOINT AS A BASIS FOR CERTIFICATION OF ARTIFICIAL INTELLIGENCE

M. Poretschkin, F. Rostalski, J. Voosholz et al.,Fraunhofer IAIS, 2019

此外,德国人工智能平台Lernende Systeme对人工智能的认证进行了探讨 (White paper: Certification of AI systems)。TüV 联合会(TüV VERBAND)与Fraunhofer HHI研究院合作发布了可审计AI系统的白皮书(White paper: Towards Auditable AI system)。

欧洲议会在2020年发布的“人工智能,机器人和相关技术在伦理方面的框架”,设定了AI,机器人及相关技术开发的一些伦理原则:human-centric, human-made and human-controlled artificial intelligence, robotics and related technologies;以人类为中心,人类制造,人类控制的人工智能,机器人及相关技术mandatory compliance assessment of high-risk artificial intelligence, robotics and related technologies;高风险人工智能,机器人及相关技术的强制性符合性评估safety, transparency and accountability;安全,透明和责任承担safeguards and remedies against bias and discrimination;防止偏见和歧视right to redress;救济的权利social responsibility and gender equality in artificial intelligence, robotics and related technologies;人工智能,机器人及相关技术中的社会责任和性别平等environmentally sustainable artificial intelligence, robotics and related technologies;人工智能,机器人及相关技术的环境可持续性respect for privacy and limitations on the use of biometric recognition;尊重隐私和限制生物特征识别的使用good governance relating to artificial intelligence, robotics and related technologies, including the data used or produced by such technologies.人工智能,机器人及相关技术的良好治理,包括这些技术使用或生成的数据

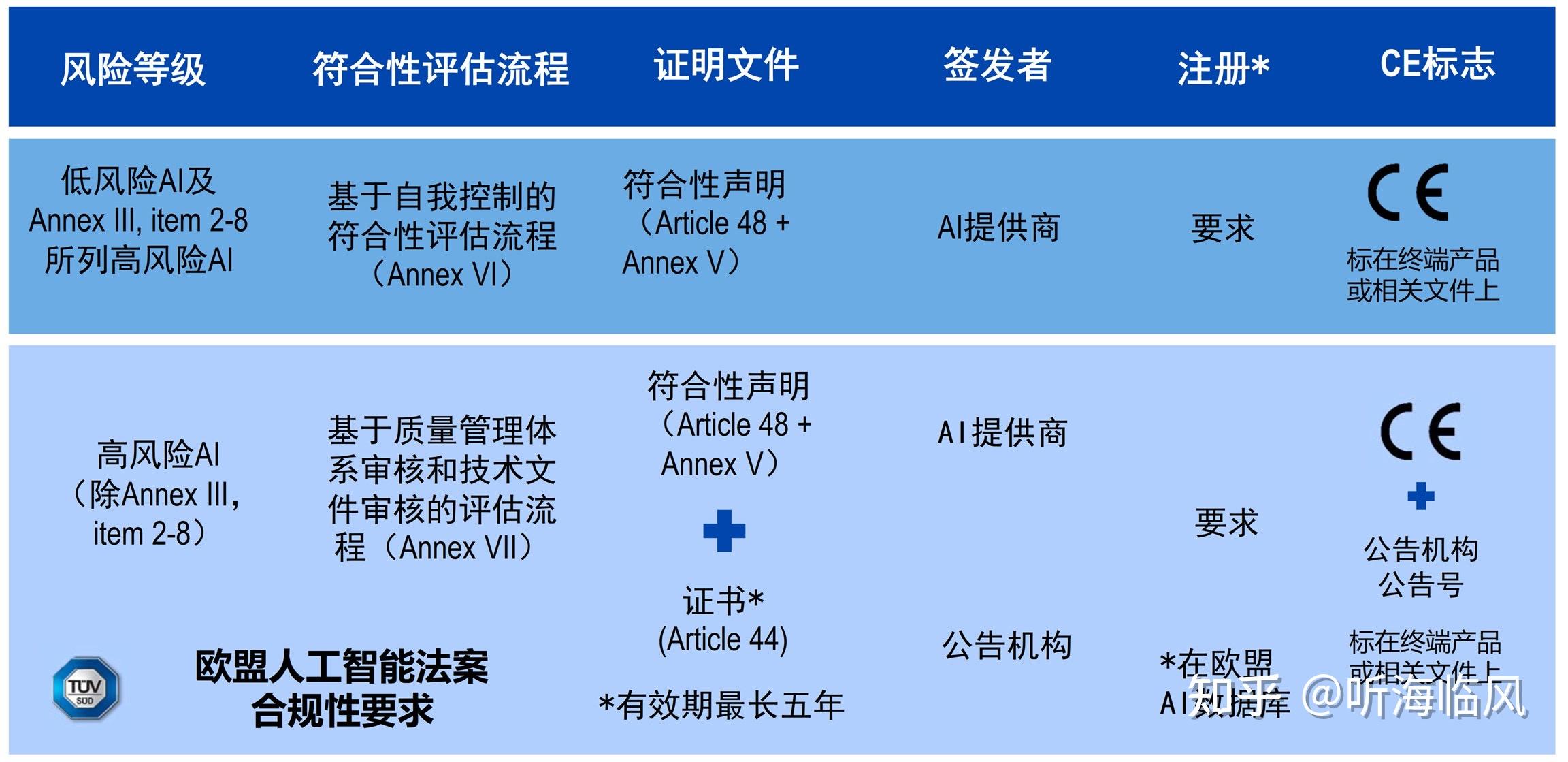

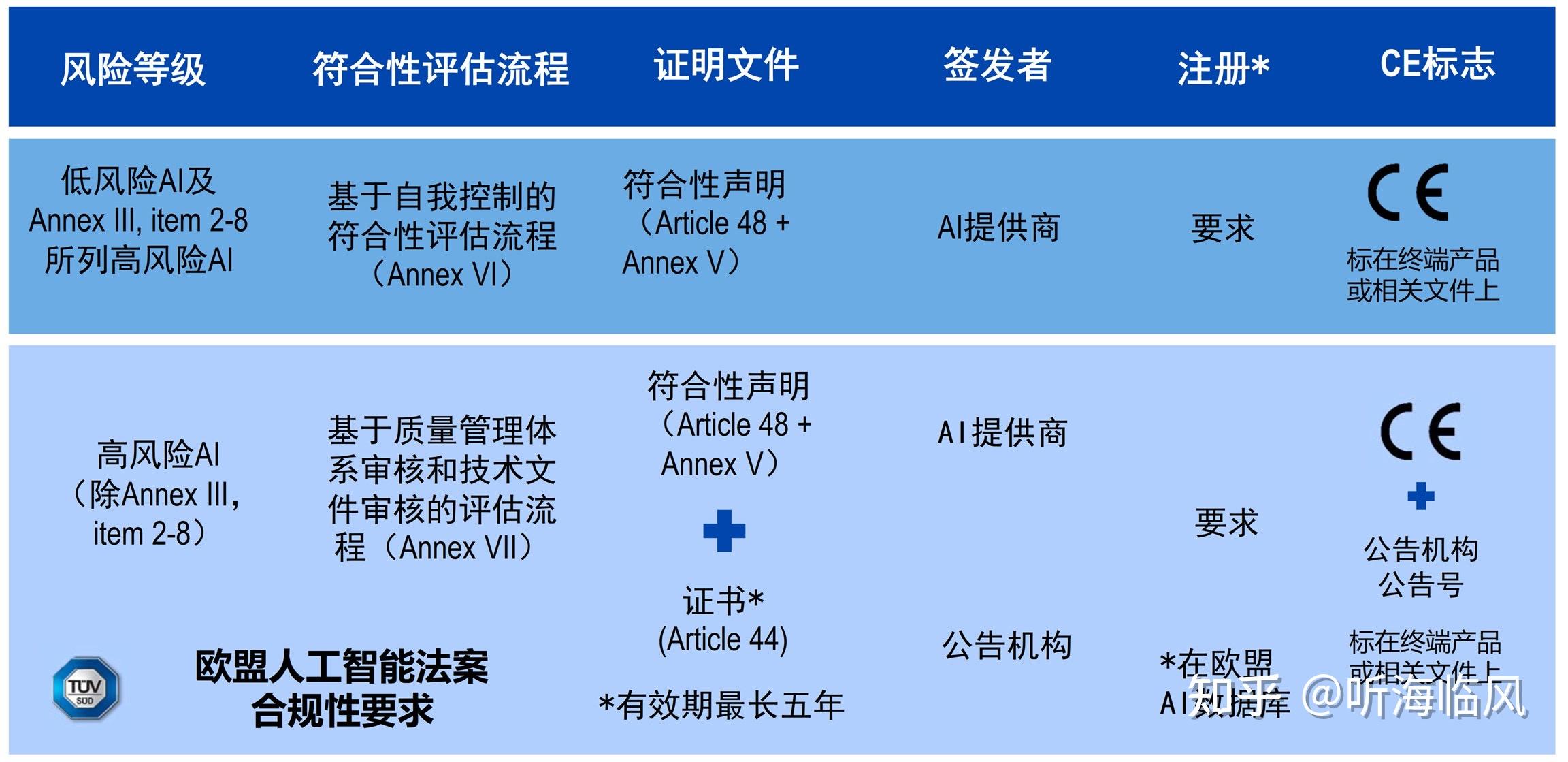

2021年4月21日,欧盟委员会发布了欧盟议会和欧盟理事会《关于制定人工智能统一规则》的提案(以下简称“草案”),以面对人工智能应用日益增长所带来的风险及机会。在欧盟的人工智能法案草案中提供了多个政策级别, 监管力度从自愿标注到全面强制管控逐级加严,最终可能执行的是以风险评估为基础的分级管理制度。其核心的监管机制是建立类似产品认证的公告机构强制认证制度。此法案将于2024年强制执行。

关于该法案的详细介绍可以参考以下系列文章。人工智能如何满足欧盟监管法规要求?

欧盟人工智能法案-政策选项

欧盟人工智能法案:风险等级

欧盟人工智能法案-惩罚力度